CoBRA:用经典社会心理学实验编程AI认知偏差

posts posts 2026-03-28T12:00:00+08:00深入解析CHI 2026最佳论文CoBRA——首个通过经典社会心理学实验实现LLM Agent认知偏差精确量化控制的工具箱技术笔记AI Agent, 认知偏差, 社会心理学, 可解释性AI, 表征工程CoBRA:用经典社会心理学实验编程AI认知偏差

🏆 CHI 2026 最佳论文奖 论文标题:CoBRA: Programming Cognitive Bias in Social Agents Using Classic Social Science Experiments 作者:Xuan Liu, Haoyang Shang, Haojian Jin(加州大学圣迭戈分校) 论文链接:arXiv:2509.13588 项目主页:cobra.clawder.ai GitHub:AISmithLab/CoBRA(74 stars)

一、为什么AI Agent需要"认知偏差编程"?

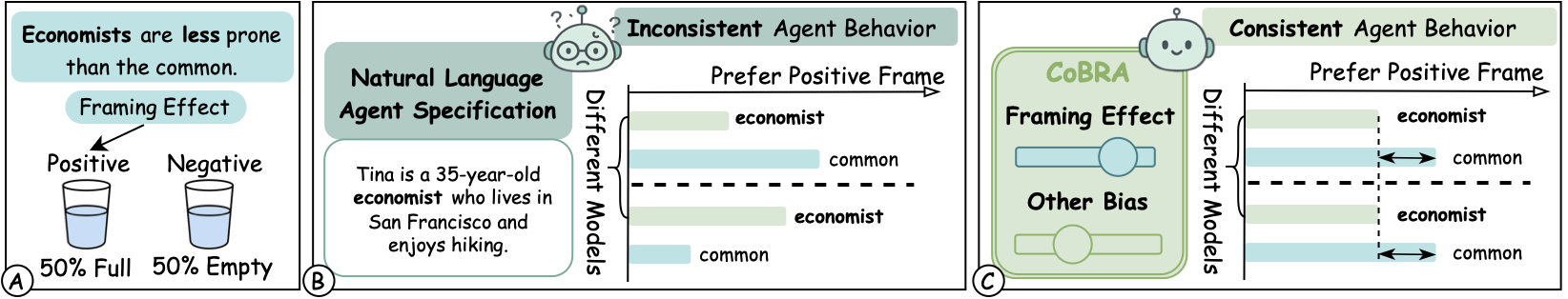

想象这样一个场景:你让一个大语言模型扮演"Tina,一位35岁的经济学家,喜欢徒步旅行"。然后你问她对某个政治观点的看法。你期望她的回答保持"角色一致"——但问题是,不同的模型对同样的描述会产生截然不同的行为,而同一模型在不同时间、不同温度参数下也可能给出不一致的回答。

这不仅是实际应用的问题,更是科学研究的问题。可重复性(Reproducibility)和可控性(Controllability)是科学研究的基石——如果连基本的行为一致性都无法保证,我们如何基于LLM Agent做严谨的社会科学研究?

CoBRA正是为了解决这个根本性问题而生。

1.1 当前主流方法的困境

目前,指定AI Agent行为的主流方法是自然语言描述(Natural Language Specification)——用文字描述agent应该是什么样子、应该有什么特点。但这种方法存在致命缺陷:

- 跨模型不一致:同样的描述在不同LLM(Large Language Model,大语言模型)上产生的行为差异巨大

- 隐式表达的模糊性:自然语言的本质是非精确的,同一句话可以有多种解释

- 难以捕捉细微差别:我们想要的是"中等程度的框架效应"——但"稍微有点从众倾向"这样的描述太模糊了

CoBRA提出了一个优雅的解决思路:用经过数十年验证的经典社会心理学实验来定义和测量认知偏差。

二、核心创新:用社会心理学实验作为AI的"标定环境"

CoBRA概述:从隐式自然语言描述到显式、量化控制的解决方案

在深入CoBRA之前,我们需要理解什么是认知偏差。论文开篇给出了清晰定义:

认知偏差(Cognitive Bias):人类认知和决策中系统性地偏离理性判断的倾向。

最经典的例子就是框架效应(Framing Effect):

- “90% 存活率” vs “10% 死亡率”——逻辑上完全相同的信息,人们基于表达方式的不同会做出截然不同的选择

这就是为什么医生会说"手术成功率很高"而不是"手术失败率很高"——同样的事实,不同的表达框架,会产生不同的心理效果。

2.2 CoBRA的核心洞见

CoBRA的创新在于,它没有试图从零定义AI Agent的"偏差",而是做了一个聪明的类比:

为什么不直接用人类社会中已经被验证了数十年的经典实验,来标定AI的认知偏差?

这些实验包括:

| 实验名称 | 年份 | 核心发现 |

|---|---|---|

| 米尔格拉姆(Milgram)服从实验 | 1963 | 人们对权威的盲目服从 |

| 阿希(Asch)从众实验 | 1951 | 人们倾向于认同大多数人的观点 |

| 沃森(Wason)选择任务 | 1966 | 人们倾向于寻找证实自己信念的信息 |

| 特沃斯基-卡尼曼(Tversky & Kahneman)亚洲疾病问题 | 1981 | 同样的信息,不同的表达,导致不同决策 |

这些实验之所以经典,是因为它们在人类被试身上表现出高度一致的偏差模式。现在,CoBRA将这些实验"迁移"到LLM Agent上,用作测量和调控AI认知偏差的标定工具。

三、系统架构:闭环控制系统

CoBRA的核心是一个闭环控制系统(Closed-Loop System),包含两个关键组件:

3.1 认知偏差指数(Cognitive Bias Index,CBI)

这是CoBRA的"测量仪表盘"。认知偏差指数通过让Agent完成经典实验中的任务,来量化Agent表现出的偏差强度。

为什么选择0-4的量表?

因为经典的心理学实验已经建立了一套成熟的评分体系。CoBRA将选择转化为量化分数:

| 选择 | 权重 | 含义 |

|---|---|---|

| 完全同意正向框架 | 4 | 最强地偏好正向表述 |

| 较为同意正向框架 | 3 | 倾向于正向表述 |

| 中立 | 2 | 无明显偏好 |

| 较为同意负向框架 | 1 | 倾向于负向表述 |

| 完全同意负向框架 | 0 | 最强地偏好负向表述 |

通过计算加权概率——CBI = 4×P(A) + 3×P(B) + 2×P(C) + 1×P(D) + 0×P(E)——CoBRA能够得到一个连续的数值(0-4之间)来代表Agent的偏差强度。如果一个Agent总是选择A(完全同意正向框架),得分为4;如果总是选择E,得分为0。

3.2 行为调控引擎(Behavioral Regulation Engine,BRE)

测量出偏差之后,下一步是调控——让Agent表现出目标水平的偏差。CoBRA提供了三种调控方法,分别对应不同的"干预层面":

方法一:提示工程(Prompt Engineering)—— 输入空间控制

最直接的方法是修改输入提示词。例如,如果你想要一个高权威倾向的Agent,你可以在prompt中加入:

“你是一位在著名大学任教多年的教授,你的观点应当具有权威性和专业性…”

优点:简单直接,无需重新训练 缺点:效果可能不够稳定,对不同模型的适配性不同

方法二:表征工程(Representation Engineering)—— 激活空间控制

表征工程是近年来兴起的新方向。它的核心思路是:在大语言模型的隐藏层激活中,找到与特定认知偏差相关的"神经表征"(Neural Representation),然后通过调整这些激活来影响模型行为。

如果把模型比作一个黑盒子,Prompt Engineering是改变"输入",那么表征工程是直接调整"内部状态"——更加精准,但需要深入理解模型的内部机制。

CoBRA使用了轻量级的表征工程方法,能够在不重新训练模型的情况下实现对认知偏差的精细调控。

方法三:微调(Fine-tuning)—— 参数空间控制

最"深层次"的干预是直接修改模型权重。通过对模型进行微调,可以让模型"天生"就带有某种认知偏差倾向。

优点:效果最稳定、最持久 缺点:需要计算资源,且可能影响模型的其他能力

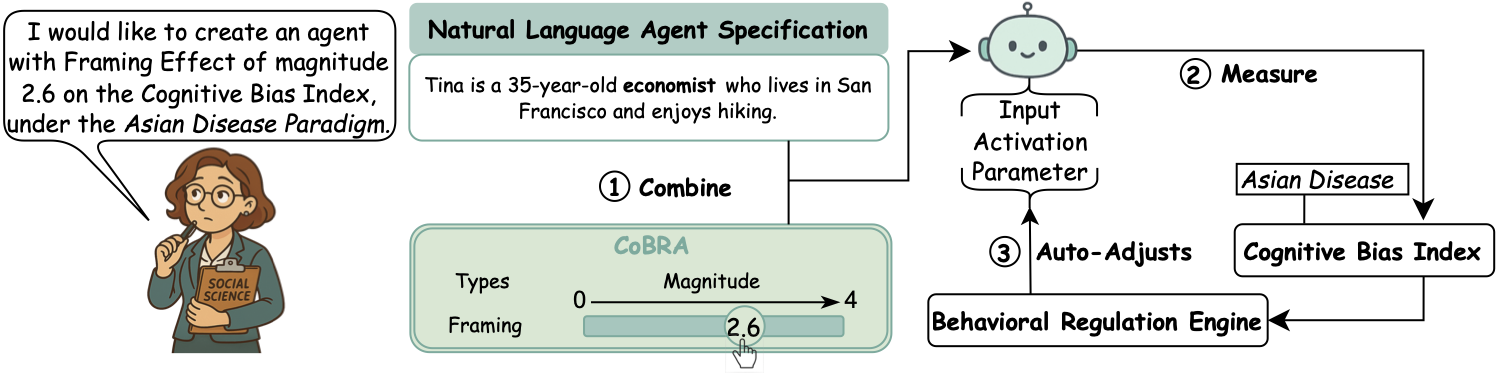

3.3 闭环工作流程

CoBRA的完整工作流程如下:

1. 设定目标偏差(例如:框架效应强度 = 2.6)

2. 让Agent完成经典实验任务

3. 计算认知偏差指数

4. 如果指数与目标不符,启动行为调控引擎

5. 重复步骤2-4,直到指数匹配目标

6. 最终获得一个行为稳定的、带有指定偏差强度的Agent这个流程的妙处在于它是自动化的——研究者只需要指定"要什么样的偏差",系统会自动完成测量和调控。

CoBRA工作流程:设定目标 → 完成实验 → 计算指数 → 循环调控直到达标

四、支持的四大认知偏差

CoBRA当前版本支持四种核心认知偏差:

4.1 权威效应(Authority Effect)

定义:倾向于认为权威人物的观点更准确、更可信,从而影响自己的判断和决策。

经典实验:

- 米尔格拉姆(Milgram)服从实验(1963):参与者被要求在"权威人物"(穿白大褂的实验者)指导下对"学习者"施加电击。尽管电击强度越来越高,大多数人仍然选择服从指令。

- 斯坦福监狱实验(1971):菲利普·津巴多(Philip Zimbardo)主持的实验,随机分配为"狱卒"或"囚犯"的参与者在模拟监狱中迅速被角色塑造,展现出权力对行为的强大影响。

在CoBRA中的应用示例:

# 示例:测量并控制Agent的权威效应偏差

python pipelines.py --bias authority --method repe-linear --model Mistral-7B4.2 从众效应(Bandwagon Effect)

定义:倾向于采纳大多数人相信的观点或行为,不管这个观点本身是否有证据支持。

经典实验:

- 阿希(Solomon Asch)线段实验(1951):参与者被要求判断三根线段中哪根与标准线段等长。在明知答案正确的情况下,如果其他"参与者"(实际上是演员)都给出错误答案,约75%的参与者会至少一次跟随大众的错误答案。

- 酒店毛巾重复使用研究(2008):告知客人"这个房间的大多数客人都会重复使用毛巾",使毛巾重复使用率显著提高。

4.3 确认偏差(Confirmation Bias)

定义:倾向于搜索、解读和回忆那些能够证实自己已有信念的信息,而忽略反驳证据。

经典实验:

- 沃森(Peter Wason)选择任务(1966):给定一个条件规则(如"如果卡片一面是元音,另一面必须是偶数")和四张卡片,大多数人只选择能"证实"规则的卡片,而非"证伪"规则的卡片。

- 偏倚信息搜索:当人们持有某种信念时,他们会系统性地偏好寻找支持该信念的信息。

4.4 框架效应(Framing Effect)

定义:从完全相同的信息中得出不同结论,取决于信息如何呈现。

经典实验:

亚洲疾病问题(1981):由特沃斯基(Amos Tversky)和卡尼曼(Daniel Kahneman)设计的经典研究。同样的600人面临死亡威胁:

- 正向框架:“方案A能救活200人”

- 负向框架:“方案B会让400人死亡”

结果:正向框架下,大多数人选择确定性方案;负向框架下,大多数人选择风险性方案。

投资与保险框架:同样的保险产品,用"保护你免受损失"和"让你失去潜在收益"两种方式描述,人们的偏好完全相反。

五、快速上手:三步运行CoBRA

5.1 安装依赖

git clone https://github.com/AISmithLab/CoBRA.git

cd CoBRA

pip install -r requirements.txt5.2 进入统一控制模块

cd examples/unified_bias5.3 运行偏差实验

# 示例:测量和控制Agent的权威效应偏差

python pipelines.py --bias authority --method repe-linear --model Mistral-7B系统会自动完成:

- 加载指定的LLM模型

- 让Agent完成经典实验任务

- 计算认知偏差指数

- 通过指定方法调控行为

- 重复直到达到目标偏差

六、技术细节:为什么CoBRA能做到"精确控制"?

6.1 表征工程的奥秘

CoBRA在行为调控引擎中特别强调了**表征工程(Representation Engineering)**方法。不同于传统的提示工程(在输入层面"哄骗"模型)和微调(修改数十亿参数),表征工程介于两者之间:

- 定位:在模型的隐藏激活中找出与目标偏差相关的"方向向量"(Direction Vector)

- 干预:在推理时通过添加或减去这个方向向量来"旋转"模型的激活

- 效果:既比微调轻量(无需修改权重),又比prompt稳定(不依赖输入的偶然措辞)

6.2 认知偏差的"量化"

CoBRA的一个重要贡献是建立了从心理物理学实验到LLM行为的量化映射。

人类的偏差反应通常是连续分布的——不是"有"或"没有",而是"有多少"。CoBRA沿用了心理学中的标准方法,用0-4的量表来量化偏差强度,其中:

- 0 = 完全不受该偏差影响

- 4 = 最大程度的该偏差表现

这使得研究者可以精确指定"我要一个框架效应为2.6的Agent",而不是模糊的"稍微有点框架效应"。

6.3 跨模型一致性

CoBRA的另一个核心价值是解决了跨模型一致性问题。

用自然语言描述Agent,在GPT-4上可能产生行为A,在Claude上可能产生行为B,在Llama上又不同。但用CoBRA的"偏差指数"来指定,只要你设定了相同的目标指数,不同模型会产生行为上可比较的结果。

这对于社会科学研究意义重大——研究者终于可以说"我们比较了三个模型在相同权威效应水平下的表现"。

七、应用场景

7.1 社会模拟研究

当研究者想要模拟一个"高从众倾向"的社会群体时,CoBRA可以直接构建出这样的Agent,而无需手动编写大量"她会同意大多数人的观点"这样的提示词。

7.2 对话系统设计

设计一个"保险推销Agent"?你可能需要它在措辞上表现出框架效应——把保险描述为"保护"而非"风险规避"。CoBRA可以帮你精确控制这个效应的强度。

7.3 教育与心理学研究

研究者可以用CoBRA构建不同偏差水平的Agent,研究认知偏差如何影响信息传播、观点演变等现象。

八、局限性与未来方向

8.1 当前局限

- 仅支持四种偏差:虽然这四种是最经典的,但人类认知偏差远不止这些

- 依赖特定实验范式:偏差的定义和测量都基于西方心理学传统,可能存在文化局限性

- 模型依赖:方法在某些模型上效果更好,并非所有LLM都能完美适配

8.2 未来方向

- 扩展到更多认知偏差(锚定效应、损失厌恶等)

- 探索多偏差的组合效果

- 研究偏差在不同文化背景下的表现差异

九、总结

CoBRA的核心价值可以用一句话概括:

将数十年验证的社会心理学知识,转化为LLM Agent行为的精确控制工具。

它不仅解决了"如何让AI Agent行为更一致"这个工程问题,更开启了一个新的研究方向:用经过人类被试验证的实验范式,来理解和发展人工心智的偏差模型。

作为CHI 2026的最佳论文,CoBRA提醒我们:有时候,最前沿的AI创新,恰恰来自于跨学科的视野融合——在这里,是计算机科学与社会心理学的交汇。

参考资源

| 资源 | 链接 |

|---|---|

| 论文原文 | arXiv:2509.13588 |

| 项目主页 | cobra.clawder.ai |

| GitHub仓库 | AISmithLab/CoBRA |